Правительство Австралии объявило о проведении внезапной восьминедельной консультации, в ходе которой будет выясняться, следует ли запретить какие-либо инструменты искусственного интеллекта, представляющие "повышенный риск".

Другие регионы, включая США, Европейский Союз и Китай, в последние месяцы также начали принимать меры по пониманию и потенциальному снижению рисков, связанных с быстрым развитием ИИ.

1 июня министр промышленности и науки Эд Хусик объявил о выходе двух документов - документа для обсуждения "Безопасный и ответственный ИИ в Австралии" и отчета о генеративном ИИ от Национального научно-технического совета (NSTC).

Документы были опубликованы одновременно с консультацией, которая продлится до 26 июля.

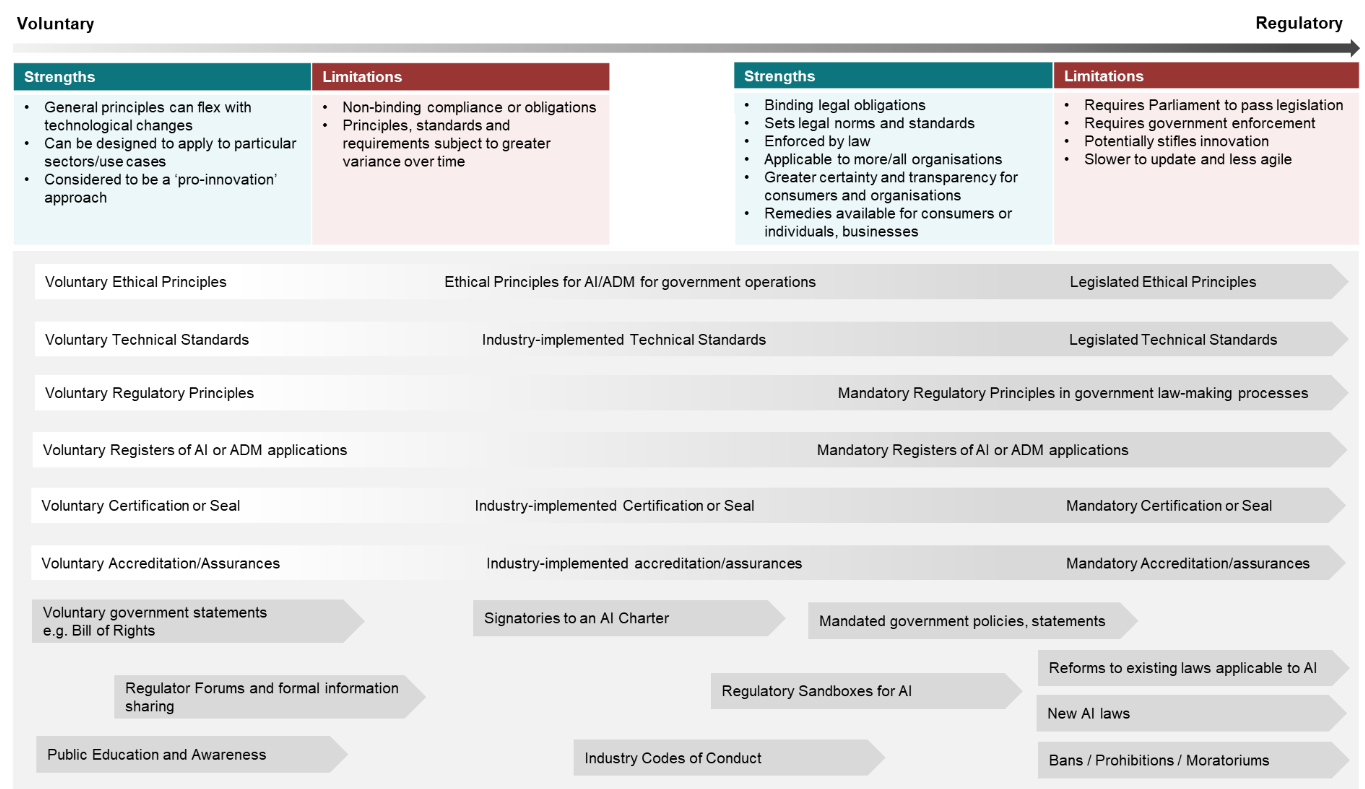

Правительство хочет получить отзывы о том, как поддержать "безопасное и ответственное использование ИИ", и обсудить, следует ли использовать добровольные подходы, такие как этические рамки, необходимо ли специальное регулирование или использовать сочетание обоих подходов.

Один из вопросов в консультации прямо спрашивает: "Следует ли полностью запретить какие-либо приложения или технологии ИИ с высоким риском?" и какие критерии следует использовать для определения таких инструментов ИИ, которые следует запретить.

Проект матрицы рисков для моделей ИИ был включен для отзывов во всеобъемлющий документ для обсуждения. В нем, хотя и только для примера, ИИ в самодвижущихся автомобилях отнесен к категории "высокого риска", в то время как генеративный инструмент ИИ, используемый для таких целей, как создание медицинских карт пациентов, считается "средним риском".

#AI уже является частью нашей жизни. По мере развития технологии мы должны обеспечить ее соответствие ожиданиям австралийцев в отношении ответственного использования. Примите участие в дискуссии @IndustryGovAu, ниже. https://t.co/Gz11JCXlsG

- Главный ученый Австралии (@ScienceChiefAu) 1 июня 2023 г.

В документе подчеркивается "положительное" использование ИИ в медицинской, инженерной и юридической отраслях, а также его "вредное" применение, например, инструменты глубокой подделки, использование в создании фальшивых новостей и случаи, когда боты ИИ побуждали к членовредительству.

Предвзятость моделей ИИ и "галлюцинации" - бессмысленная или ложная информация, генерируемая ИИ - также были подняты в качестве проблем.

В документе для обсуждения утверждается, что внедрение ИИ в стране находится на "относительно низком уровне", поскольку она имеет "низкий уровень общественного доверия". В документе также указывается на регулирование ИИ в других юрисдикциях и временный запрет Италии на ChatGPT.

Между тем, в отчете NTSC говорится, что Австралия обладает некоторыми преимущественными возможностями ИИ в робототехнике и компьютерном зрении, но ее "основной фундаментальный потенциал в [больших языковых моделях] и смежных областях относительно слаб", и добавляется:

"Концентрация ресурсов генеративного ИИ в руках небольшого числа крупных транснациональных и преимущественно американских технологических компаний создает потенциальные риски для Австралии".

Далее в отчете обсуждалось глобальное регулирование ИИ, приводились примеры генеративных моделей ИИ и высказывалось мнение, что они "вероятно, окажут влияние на все сферы - от банковского дела и финансов до государственных услуг, образования и творческих индустрий".

Глаз ИИ: 25 тысяч трейдеров ставят на биржевые ставки ChatGPT`s, ИИ отстойно играет в кости и многое другое

Источник